github地址:GitHub – THUDM/ChatGLM2-6B: ChatGLM2-6B: An Open Bilingual Chat LLM | 开源双语对话语言模型

一、项目介绍:

自3月14日发布以来, ChatGLM-6B 深受广大开发者喜爱,截至 6 月24日,来自 Huggingface 上的下载量已经超过 300w。

为了更进一步促进大模型开源社区的发展,我们再次升级 ChatGLM-6B,发布 ChatGLM2-6B 。

在主要评估LLM模型中文能力的 C-Eval 榜单中, 截至6月25日 ChatGLM2 模型以 71.1 的分数位居 Rank 0 ,ChatGLM2-6B 模型以 51.7 的分数位居 Rank 6,是榜单上排名最高的开源模型。

二、环境安装

- 平台:windows 10

- 编译器:pycharm

- cuda 11.3

- cudnn 8.2.0.53

pip install -r requirements.txt三、执行代码

第一种方式启动页面版本

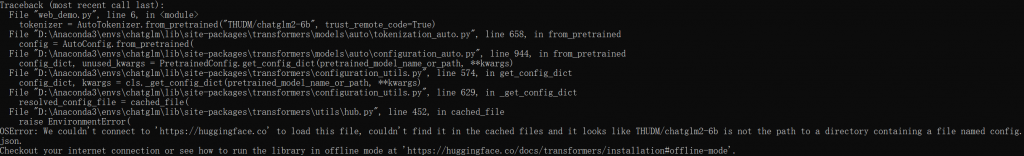

python web_demo.py遇到一个报错

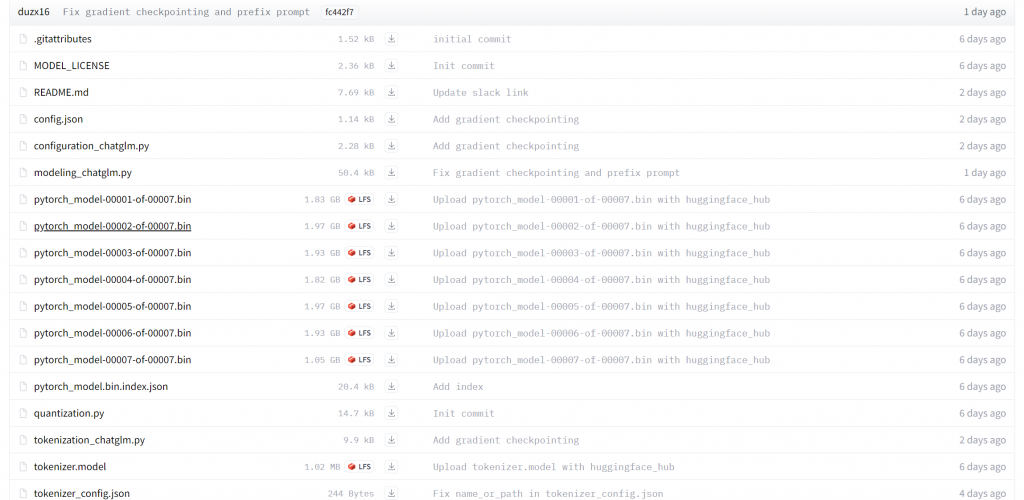

解决方法:从https://huggingface.co上将全部模型包进行下载

链接:https://pan.baidu.com/s/11DXurqKc_RzCjfITRxu5EQ?pwd=f55v

提取码:f55v

–来自百度网盘超级会员V4的分享

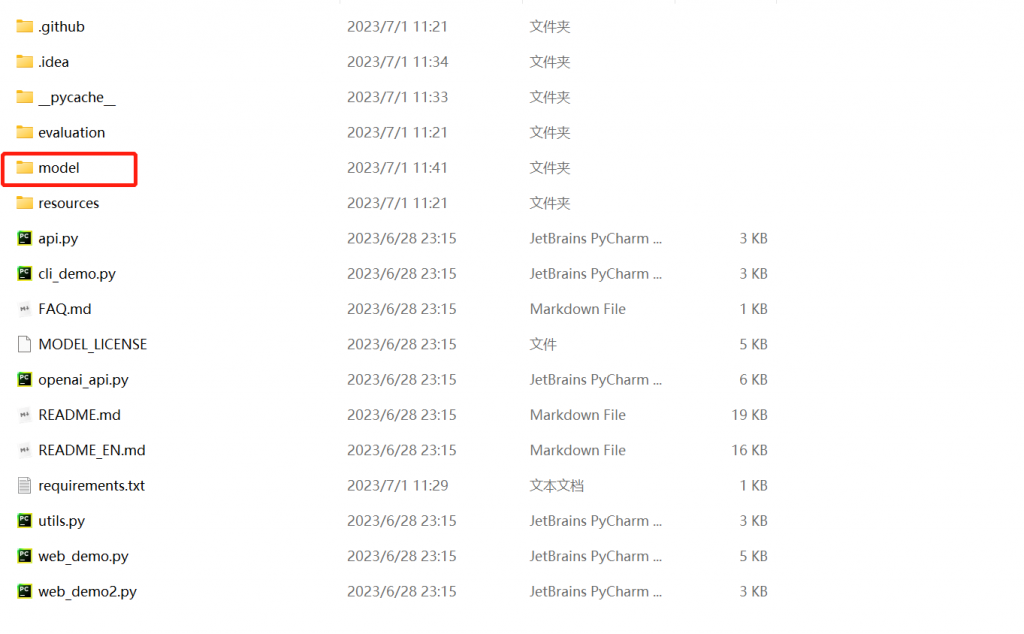

将下载好的模型文件存放到新建的model文件中

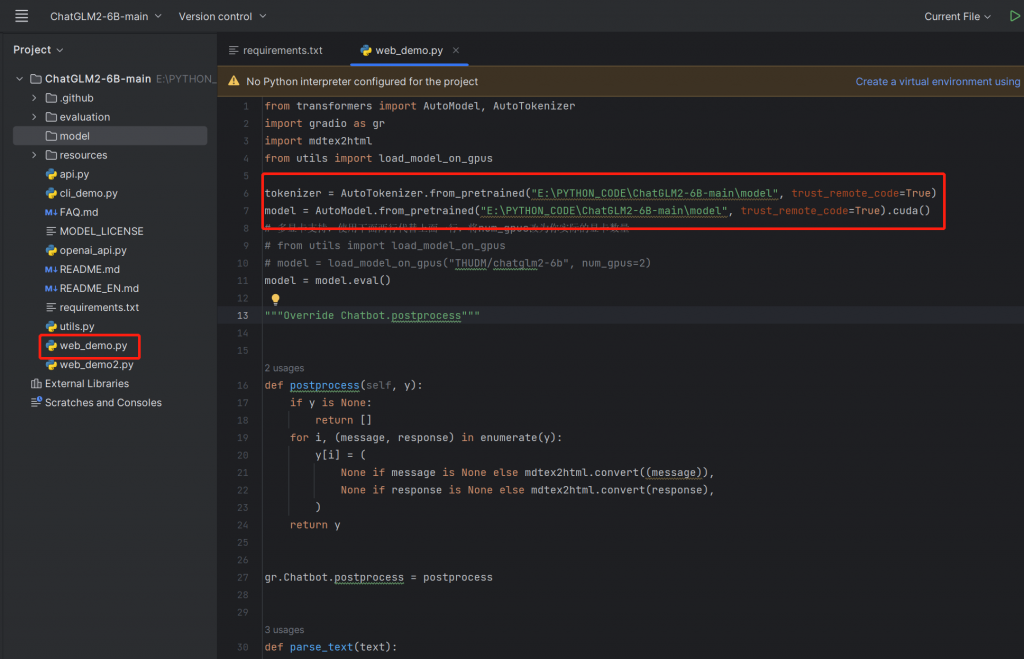

修改模型路径

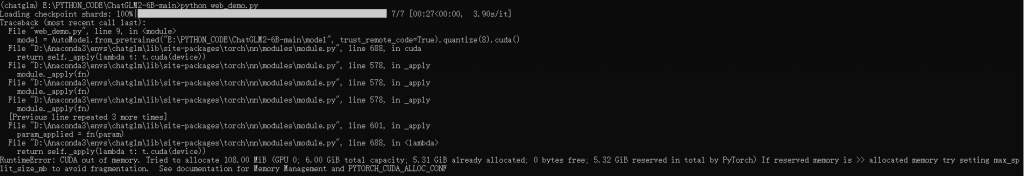

如果遇到以下问题表示内存不足

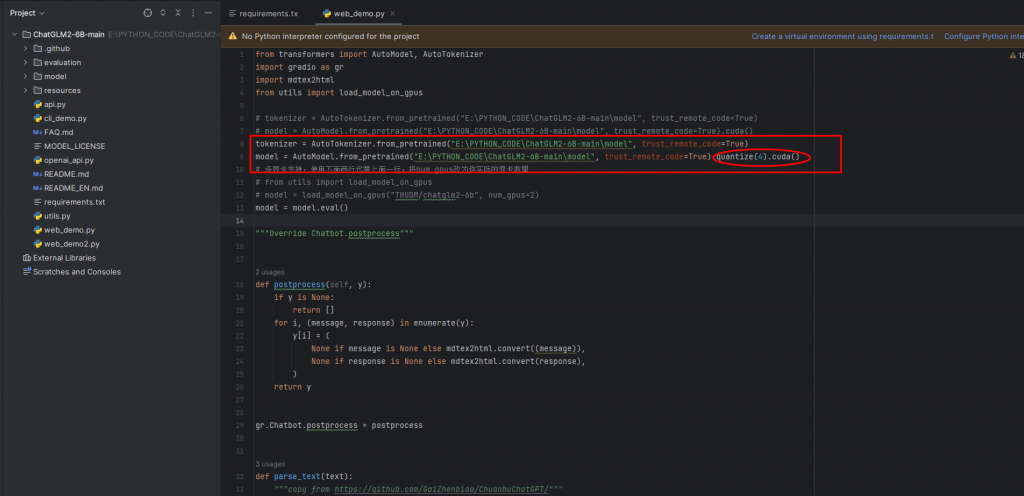

需要将参数调小

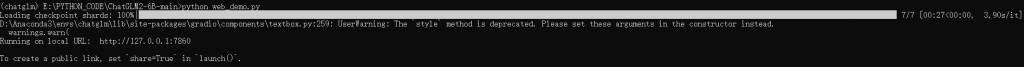

运行成功的标志

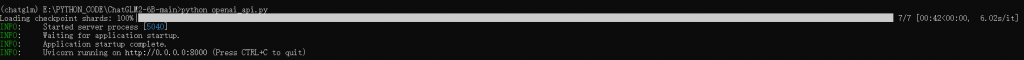

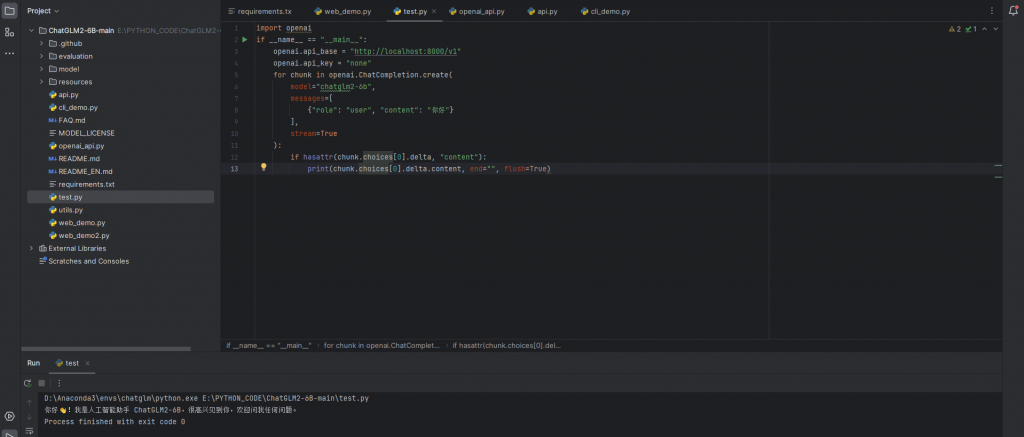

第二种方式启动api

创建测试文件test.py

import openai

if __name__ == "__main__":

openai.api_base = "http://localhost:8000/v1"

openai.api_key = "none"

for chunk in openai.ChatCompletion.create(

model="chatglm2-6b",

messages=[

{"role": "user", "content": "你好"}

],

stream=True

):

if hasattr(chunk.choices[0].delta, "content"):

print(chunk.choices[0].delta.content, end="", flush=True)启动api服务

python openai_api.py

使用test.py 打印输出表示成功

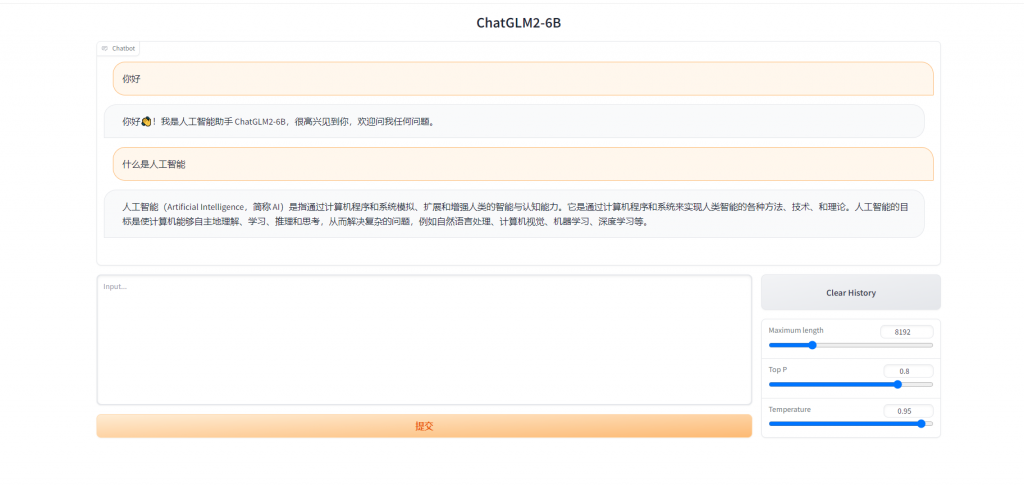

四、效果展示